ChatGPT も含めて今人工知能(AI)と呼ばれるモデルの背景に、1950年ぐらいから研究が始まったニューラルネットワークと呼ばれる結合性を学習に応じて変化させられる回路が存在することは、理解しているが、ChatGPT がほとんどチューリングテストをクリアしているのを経験すると、簡単なコンパートメントしかないニューラルネットでも、規模を拡大さえすればここまで可能なのかと感動する。一方で、この事実を突き詰めると、サルもネットワークを拡大すれば人間になれると言うことで、心配した哲学者によって、「単語の意味や機能を一般化することで、全く経験したことがない文章も理解できるようになる人間の言語獲得過程は、ニューラルネットでは再現できない」と予測した。

実際、人間は ChatGPT のように言語を処理しているのかという問題について様々な実験が行われている。昨年紹介した言語に対する人間の脳の反応と深層学習モデル(実際には GPT-2 )を比べたプリンストン大学の研究は、完成した我々の脳ネットワークはGPTと同じように単語の並びの確率論的予想に基づくことを示していた(https://aasj.jp/news/watch/19237)。しかし ChatGPT の学習モデルでは出来ないことがあるのは明らかだ。ただこの困難がニューラルネットやトランスフォーマーのようなアルゴリズム自体の問題かどうかはやってみないとわからない。

今日紹介するニューヨーク大学とスペインPompeu Farba大学からの論文は、一般的なニューラルネットをメタ学習という方法で教育することで、人間と同じように単語の意味を一般化して捉え、新しい文章に使えることを示した研究で、10月25日 Nature にオンライン掲載された。タイトルは「Human-like systematic generalization through a meta-learning neural network(ニューラルネットがメタ学習すると人間のような系統的一般化が出来るようになる)」だ。

この研究の売り、は Meta-learning compositionality(MLC) という学習方法でニューラルネットに学習させたという一点にある。調べてみるとメタ学習は「learning to learn」といわれるように学習法を学ばせる方法で、一般的ニューラルネット(NVIDIA Titan)を用い、エンコーダーとデコーダーの2つのコンパートメントを持つトランスフォーマーがあればできる。この Titan は30万円ほどのGPUシステムなので、現在広く使われている高機能の新しいGPUマシンと比べると機能は低い。いずれにせよ、私はどう学習させているのかについては全く素人なので、理解できていない。

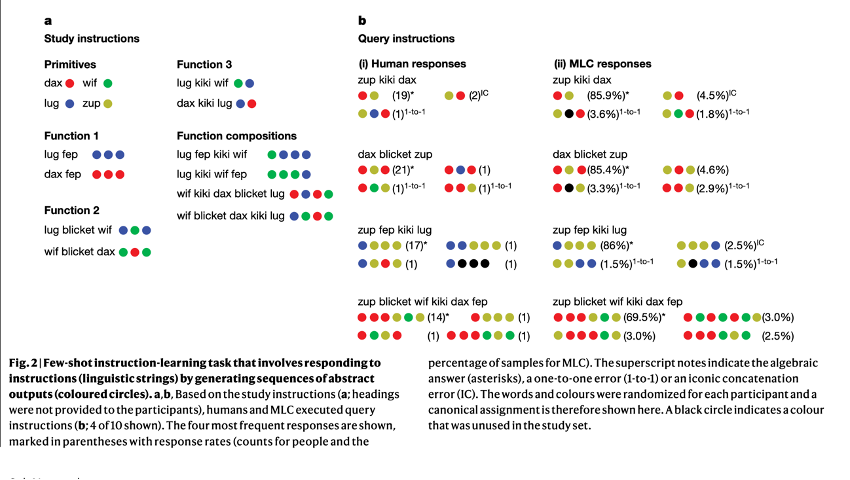

あとは、一般化の能力を調べるためのタスクが重要で、図2に示される色に当たる記号(primitiveと表示されている)と、その並べ方を指示する記号(functionと表示されている)を、few shot learning と呼ばれる少量の訓練データを用いて学習させることで、学習した中から法則を考えて記号の並びを合成したり理解出来るようになるかを調べている。

オープンアクセスなので図をそのまま引用させていただき説明すると、最初の赤や緑の円は primitive と呼んでいるが、一種の名詞に当たる。この色の並びを決めるのが function で、fep=は3回繰り返すを意味し、lug fepは青を三回繰り返すになる。他にもいくつかの機能が示されているが、色の並びを見ると、我々はその機能を推察することが出来る。例えば Function3 の lug kik wif の kik は青(lug)と緑(wif)を逆さまに並べると推察できる。

すなわち primitiveとfunction が使われた記号と結果を少し学ぶだけで、記号の指示に合わせて色を並べることが出来るようになる。

実際にボランティアに同じ課題を行ってもらった結果、少し学習すれば8割程度の正解率でどんな指示にも答えられるようになる。これが Human response として示されている。この同じ課題に対し、MLC学習したニューラルネットは、正解率で人間を凌駕することが出来ており、この結果から系統的一般化が普通のニューラルネットでも可能であるというのが結論になる。

結果は以上で、哲学者(著者は Fodor をわざわざ引用している)が人間の脳機能と機械についてその場の思いつきで考えたことは、科学や技術の進歩で否定されてしまうことを見事に示している。

私も Fodor の論文を読んでみたが、勿論全てが答えられているわけではなく、ともかく初歩的な一般化機能がニューラルネットにも存在することを示したと考えればいい。従って、今後哲学からも様々な批判が続くように思える。

論文を読んでいて、最も感心したのが、MLC による学習と人間の学習を比べていくことで、子供の言語獲得過程を解析できるようになる可能性が示されている点だ。この領域にはチョムスキーという大御所も控えている。このように、AI はますます人間に近づいていると実感する。

最も感心したのが、MLC による学習と人間の学習を比べていくことで、子供の言語獲得過程を解析できるようになる可能性が示されている点。

imp.

人間の本性も意外と機械論的に理解可能なのかも?

大好きな、汎計算論的世界観に近づくか?

私も深層learningは人間の進化の過程と大変良く似てると思います。

アリストテレスがやったことは分類です。

深層学習がやることも分類です。分類すると意味と価値が発生します。何故そういう分類ができるかということに意味が派生します。ですからAIの思考は人間の思考に類似しています。